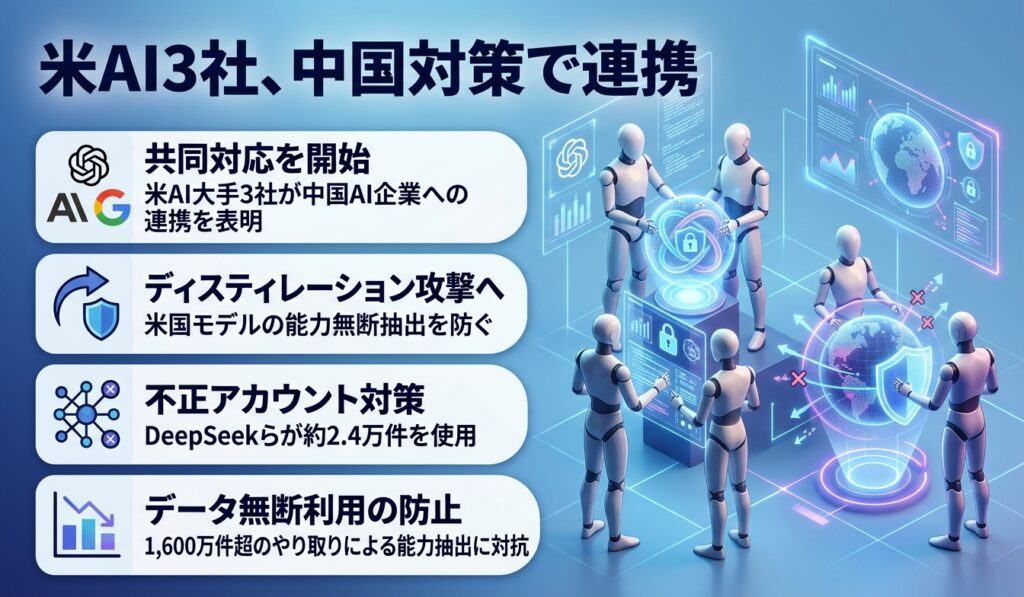

米AI3社、中国対策で連携

OpenAI・Anthropic・Googleは2026年4月6日、中国のAI企業による米国製モデルの能力抽出問題に共同で対応することを明らかにしました。

3社は2023年に設立した業界団体「Frontier Model Forum」を通じて情報を共有し、利用規約に違反する「ディスティレーション攻撃」の検出と排除に取り組みます。競合関係にある3社が技術的な脅威を前に協力する異例の動きとして注目されています。

【出典元】OpenAI, Anthropic, Google Unite to Combat Model Copying in China

不正アカウントで1,600万件を生成

ディスティレーション攻撃とは、大量の特殊なプロンプトをAPIに送り続け、得られた応答を使って自社の小さなモデルを訓練する手法です。高コストをかけて開発された大規模モデルの能力を、正規のライセンスや料金を払わずに吸収することが目的です。

AnthropicがClaudeへの攻撃として記録したデータによると、対象となったのは中国のDeepSeek・Moonshot AI・MiniMaxの3社です。3社は合計で約2万4,000件の不正アカウントを使い、1,600万件以上のやり取りをClaudeとの間に生成していました。

各社の攻撃規模と狙いは以下の通りです。

- DeepSeek:15万件超のやり取りを記録。推論タスクと、政治的に敏感な話題を検閲に引っかからずに扱う方法の学習を標的にしていました

- Moonshot AI:340万件超と最大規模。エージェント型の推論・ツール使用・コーディング・データ分析・コンピュータビジョンなど幅広い能力を抽出していました

- MiniMax:残りの件数を占め、同様の手法で能力の抽出を試みていました

これらの行為はすべてAnthropicの利用規約に違反するもので、発覚後に各アカウントは凍結されています。

2月の個別告発から共同対応へ

今回の連携は突然始まったわけではありません。2026年2月、Anthropic・OpenAI・Googleはそれぞれ独立して「中国AI企業による産業規模のディスティレーションキャンペーン」の証拠を公表しました。各社が記録したデータには、不正アカウントの規模や使用されたプロンプトのパターンが詳細に記されていました。

これを受けて4月に入り、3社はFrontier Model Forumの枠組みを使った情報共有体制の構築へと踏み込みました。フォーラムはOpenAI・Anthropic・Google・Microsoftが2023年に設立した業界団体で、安全なAI開発の推進を目的としています。今回はこの枠組みを利用規約違反の検出と情報交換の場として活用します。

競合他社どうしがセキュリティ情報を共有するのは異例で、それだけ問題を深刻に受け止めていることの表れといえます。

ディスティレーションがAI競争を変える

ディスティレーション攻撃が問題視される背景には、AIモデル開発の巨大なコスト差があります。OpenAIやAnthropicが数百億円規模の計算資源を投じて訓練したモデルも、攻撃によって能力を「コピー」されれば、その投資効果が著しく損なわれます。

実際、DeepSeekが2025年末に公開したモデルはわずか約520万ドル(約8億円)の訓練コストで米国製トップモデルに近い性能を達成したと報告されており、業界に衝撃を与えました。訓練コストの格差がディスティレーションによって埋められているとすれば、米国AI企業の競争優位が根本から揺らぐことになります。

今回の3社連携は「業界の自主規制」の段階ですが、規制当局も注視しており、今後は政府レベルでの介入を求める声が高まる可能性があります。

まとめ

OpenAI・Anthropic・Googleが中国AI企業によるモデルコピーに共同で対応することになりました。不正アカウントを使った1,600万件超のやり取りという組織的な手口は、AIをめぐる米中の技術競争が単なるモデル開発の競争にとどまらず、知的財産をめぐる攻防にまで発展していることを示しています。業界の自主規制がどこまで機能するか、また政府の介入につながるかが今後の注目点です。