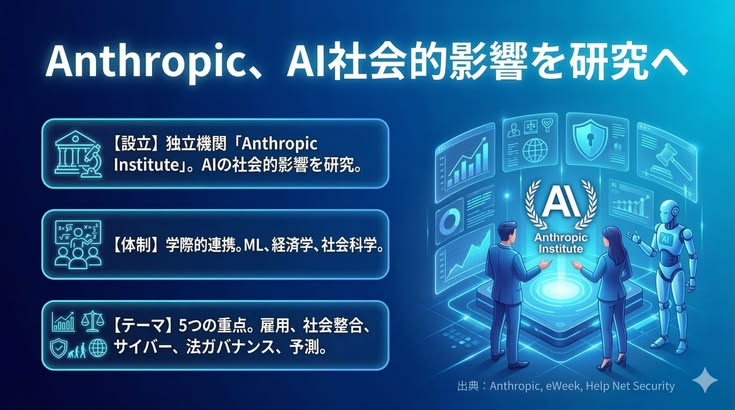

Anthropic、AI社会的影響を研究へ

Anthropicは2026年3月11日、AIが経済・法制度・社会全体に与える影響を研究する独立機関「Anthropic Institute(アンソロピック・インスティテュート)」の設立を発表しました。

共同創業者Jack Clark氏が「公益担当責任者(Head of Public Benefit)」として率い、機械学習エンジニア・経済学者・社会科学者が一体となった学際的な体制を組みます。「AI開発企業が自分たちの技術の社会的リスクを自ら研究する」という異例の取り組みとして注目されています。

【出典元】

・Introducing The Anthropic Institute – Anthropic

・Anthropic Launches Institute to Examine AI’s Impact on Jobs, Security, and Society – eWeek

・Anthropic forms institute to study long-term AI risks facing society – Help Net Security

3つの既存チームを統合した学際的な研究機関

今回設立されたAnthropicInstituteは、まったく新しい組織ではなく、Anthropic内に既にあった3つの研究チームを1つの機関として統合・再編したものです。

- Frontier Red Team(フロンティアレッドチーム)

Claudeを含む最先端AIモデルの能力と限界を意図的に「攻撃」してテストする組織。どこまで危険な使われ方ができるか、どこで失敗するかを把握することで安全設計に活かす - Societal Impacts(社会的影響チーム)

AIが現実の社会でどのように使われているかを実証的に調査する。理論ではなく実データをもとに、AIの普及がもたらす変化を記録・分析する - Economic Research(経済研究チーム)

AIが雇用・産業・所得分配・経済成長に与える影響をトラッキングする。「AIで仕事がなくなる」という議論を感覚論ではなくデータで検証する

3チームを独立した機関として束ねることで、テクニカルな安全研究・社会科学的調査・経済分析が互いに連携しやすい体制を整えます。

法・経済・安全保障・民主主義に与えるリスクを調査

Anthropic Instituteが取り組む研究テーマは以下の5軸です。

- 経済的影響と雇用代替

変革的なAIが経済活動の本質をどう変えるか。特に雇用の移行・消滅・新規創出のダイナミクスを追跡する - AIの価値観と社会への整合

AIシステムが持つ価値観が民主的な社会とどう調和するか、または衝突するかを検証する - AIが発見するサイバーセキュリティの脆弱性

AIが悪用された場合の攻撃能力を評価し、防御側への情報提供に役立てる - AIと法制度・ガバナンスの関係

AIが法体系や規制の枠組みをどう変えるか、あるいは既存の法がAIにどう適用されるかを研究する - AIの進歩軌道の予測

今後AIがどのように発展するかを予測し、社会が準備できるよう情報を提供する

Anthropicは「他の研究者や一般社会が使える情報を提供すること」を目的と明示しており、研究成果は積極的に公開する姿勢を示しています。

元DeepMind研究者と経済学者が主要テーマを担当する布陣

Anthropic Instituteの主要メンバーはAI研究にとどまらない多様なバックグラウンドを持ちます。

- Jack Clark(ジャック・クラーク)

AnthropicとOpenAI Policy(政策部門)の共同創業者。今回「Head of Public Benefit(公益担当責任者)」という新役職でInstituteを率いる - Matt Botvinick(マット・ボットビニック)

Yale Law Schoolの客員研究員、元Google DeepMind上級研究ディレクター、元プリンストン大学神経計算学教授。「AIと法の支配」の研究リーダーを担う - Anton Korinek(アントン・コリネック)

バージニア大学から参加(休職中)。「変革的AIが経済活動の本質を再形成する過程」を研究するEconomic Research部門を率いる - Zoë Hitzig(ゾーイ・ヒッツィグ)

OpenAIの元スタッフとして経済研究を経験し、AnthropicのInstituteでモデル開発と経済研究をつなぐ役割を担う

AI開発企業が自社技術のリスクを自ら研究するという構造

Anthropic Instituteが注目される理由のひとつは、「AIを作っている企業が、そのAIのリスクを外部任せにせず自ら組織的に研究する」という姿勢にあります。

AIの社会的リスクを研究する機関は世界各地の大学や独立シンクタンクにも存在しますが、最先端モデルの内部情報へのアクセスを持ちながら研究できる組織はほぼありません。

モデルを開発した当事者が内部から取り組む研究は、外部研究者が得られない深度の知見を生む可能性があります。

一方で「自社技術のリスクを自分たちで評価することに利益相反はないか」という批判的な視点もあります。Anthropicはこの点について、研究成果を積極的に公開し外部の検証に開くことで透明性を担保するとしています。

まとめ

Anthropic Instituteの設立は、AIの安全性に関する議論を「モデルの挙動レベル」から「経済・法・民主主義への影響レベル」まで広げる試みです。フロンティアレッドチーム・社会的影響・経済研究の3チームを束ねた学際的な体制は、AIがもたらす変化を技術・制度・社会の三つの視点から同時に捉えることを可能にします。AIが社会基盤そのものに組み込まれつつある今、この種の研究機関の存在意義はますます大きくなるでしょう。